Accumulando dati senza spiegazioni

Come dice il Poeta: “Nel mezzo del cammin di nostra vita mi ritrovai per una selva oscura che la diritta via era smarrita. Ahi quanto a dir qual era è cosa dura esta selva selvaggia e aspra e forte che nel pensier rinova la paura! Tant’ è amara che poco è più morte; ma per trattar del ben ch’i’ vi trovai, dirò de l’altre cose ch’i’ v’ho scorte”. Ed è proprio “di quelle cose e dell’altre” che lui-noi abbiamo “scorto“, in questo presente complesso e post rivoluzione digitale, solcato da macchine intelligenti che ci rendono sempre più “smart” – forse – ma anche, purtroppo, sempre più dipendenti da esse; che oggi proveremo qui a narrare. Lo faremo, prendendo a prestito – come sovente accade da queste parti – alcuni estratti da testi di persone “davvero sveglie” che, di questi tempi, provano a tracciare resoconti utili, e, nello stesso tempo, a fornire indicazioni non banali per orientarsi in un’epoca tumultuosa e incerta come la nostra. Un periodo in cui la società – noi tutti – ha finalmente accesso a strumenti davvero potenti e unici, che potrebbero permetterci di raggiungere uno status invidiabile e impensabile, fino a pochi decenni or sono. Uno status diffuso e accessibile a tutti. Mentre invece, la forbice della diseguaglianza e della povertà, sembra allargarsi, acuendo il disagio, la paura e l’acredine nelle persone che non riescono a raggiungere la soglia minima di tranquillità e benessere. Lo spunto di oggi ci arriva da un libro uscito l’anno scorso e che si intitola “Nuova era oscura“. Lo ha scritto James Bridle, giornalista e scrittore, ma soprattutto artista visivo, esperto di nuove tecnologie. Bridle indaga questa nostra epoca e ci restituisce stimoli e riflessioni davvero utili sul nostro stare al mondo; dentro questo tempo e questo luogo, in modo consapevole e accorto. Acuendo la nostra conoscenza e, contemporaneamente, denunciando un certo grado di acquiscenza che sembra dominare, in modo sempre più evidente, i nostri comportamenti.

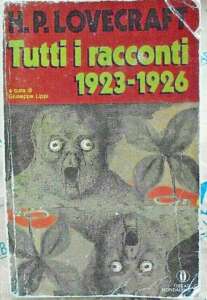

da Lovercraft (1926)

da Lovercraft (1926)

La cosa più compassionevole al mondo è, a mio avviso, l’incapacità della mente umana di mettere in relazione tutti i contenuti di cui dispone. Viviamo su una placida isola di ignoranza nel mezzo dei mari neri dell’infinito, e non era scritto che ci spingessimo oltre i nostri limiti. Le scienze, ciascuna delle quali impegnata nella propria direzione, ci hanno sinora nuociuto ben poco; tuttavia verrà il giorno in cui, mentre comporremo il puzzle con i nostri pezzi di conoscenza dissociati, ci si apriranno visioni terrificanti sulla realtà, e sulla spaventosa posizione che ci spetta al suo interno, e non potremo far altro che impazzire di fronte a quella rivelazione oppure fuggire dalla luce mortale per rifugiarci nell’oscura pace e nella tranquillità di una nuova era oscura.

… ora ci ritroviamo connessi a sterminati depositi di informazioni senza ancora avere imparato a pensare. Anzi, è vero l’esatto contrario: ciò che doveva illuminare il mondo, di fatto lo relega nell’oscurità. L’abbondanza di informazioni e la pluralità di visioni del mondo che ora ci sono accessibili attraverso internet non stanno producendo consenso su una realtà coerente, ma una realtà dilaniata dall’ossessione fondamentalista per le narrazioni semplicistiche, attraversata da teorie del complotto e politiche post-fattuali. È su questa contraddizione che nasce l’idea di una nuova era oscura: un’era in cui il valore che abbiamo dato alla conoscenza viene annientato dall’abbondanza di quella stessa redditizia merce, e in cui brancoliamo nel buio in cerca di nuovi modi per comprendere il mondo (James Bridle)

Come sostiene da molti anni, e soprattutto da tempi “non sospetti“, il sociologo della complessità Piero Dominici, ci troviamo in un’epoca di “false dicotomie“, un periodo in cui sono la confusione e la disinformazione a regnare sovrane, non il bene comune e la tendenza ad un progresso collettivo e condiviso:

La complessità sociale e organizzativa, pur nella sua particolarità, costituisce sempre un problema di conoscenza e di gestione della conoscenza di possibilità conoscitive che possono essere effettivamente selezionate e realizzate, tradotte in scelte e decisioni. Una complessità, così come l’abbiamo intesa, ulteriormente accresciuta e, contrariamente a quanto si potrebbe pensare ancor più imprevedibile – nonostante la dimensione del tecnologicamente controllato sia aumentata in maniera esponenziale – proprio in virtù dell’enorme (infinita) mole di dati e informazioni che, non soltanto non parlano mai da soli, ma determinano una condizione permanente e costante di razionalità limitata a tutti i livelli, da quello organizzativo a quello sociale.

Il rapporto uomo-macchina, la consapevolezza – o la mancanza di lucidità – alla base di questo rapporto; l’automazione progressiva e via via sempre più rapida e insostituibile nell’uso degli strumenti tecnologici per “far funzionare il mondo“; la velocità di trasmissione dei dati, e il sopraggiunto dialogo macchina-macchina, “machine learning“, che fa retrocedere e “sfuma” il ruolo dell’uomo ad una posizione meno chiara e precisa. Nonostante sia ancora l’uomo – per ora – a decidere cosa realizzare attraverso le macchine e il loro uso.

Il modo in cui pensiamo e concepiamo il nostro posto nel mondo – nonché il rapporto tra noi e gli altri e tra noi e le macchine – sarà ciò che in ultima analisi deciderà se le nostre tecnologie ci condurranno alla follia o alla pace. Ma l’oscurità di cui scrivo non è da prendere alla lettera, né vuole rappresentare l’assenza o l’occultamento della conoscenza, come sembrerebbe suggerire un concetto medievaleggiante come “era oscura”. Non vuole essere un’espressione di nichilismo o disperazione. Piuttosto, si riferisce sia alla natura che all’opportunità offerta dalla crisi attuale: da una parte, l’apparente incapacità di vedere con chiarezza ciò che abbiamo davanti e di intervenire sul mondo in modo efficace e giusto; dall’altra, una presa di coscienza dell’oscurità che ci permetta di vedere le cose sotto un’altra luce. (James Bridle)

Uno dei risvolti più impressionanti di questo regime computazionale è che è riuscito a rendersi quasi invisibile ai nostri occhi.

… la crescente incapacità della tecnologia di predire il futuro – che si parli di fluttuazioni dei mercati nelle borse digitali, di esiti e applicazioni della ricerca scientifica o della vieppiù rapida instabilità del clima globale – origina direttamente dai malintesi sulla neutralità e la comprensibilità della computazione.

Ci hanno spinto a credere che i computer rendano il mondo più limpido ed efficiente, che riducano la complessità e che agevolino soluzioni sempre migliori per i problemi che ci affliggono, che espandano il nostro campo d’azione consentendoci di coprire una sfera esperienziale in costante espansione. Ma se tutto questo fosse falso? Una lettura attenta della storia dei computer evidenzia una crescente opacità unita a una spiccata concentrazione di potere, insieme al ripiegamento di quel potere in sfere esperienziali sempre più ristrette e limitate. Reificando i problemi odierni in architetture indiscutibili, la computazione congela i problemi dell’immediato presente in dilemmi astratti e privi di soluzione; ne scaturisce un’ossessione per i limiti intrinseci di una minuta categoria di rompicapi matematici e materiali anziché per i problemi di portata ben più ampia che interessano una società davvero democratica ed egualitaria. (James Bridle)

La tecnologia non spiega se stessa e soprattutto non fornisce chiavi interpretative. L’attuale condizione umana, dipendente, sempre di più, dalle tecnologie, è una condizione di progressiva ignoranza e condizionamento dai cosiddetti progressi tecnologici se non adeguatamente supportata da meccanismi culturali profondi di comprensione e adeguamento reale ai mutamenti in corso. Costringere o essere stati costretti da un avvenimento contingente, ad usare in modo massiccio e non derogabile, l’insegnamento a distanza, per poter proseguire nel processo di scolarizzazione e apprendimento dei nostri figli e nipoti – processo obbligatorio per legge fino ai sedici anni e garantito dal dettato costituzionale – senza sapere utilizzare, nella stragrande maggioranza dei casi, (sia i professori sia gli utenti, senza soluzione di continuità), le macchine e i software, le app, gli ambienti digitali; non è sintomo di progresso, bensì di inutile complicazione dentro ad un mondo complesso di cui non sappiamo quasi nulla. Come argomenta in modo chiaro e preciso, ancora una volta, il sociologo della complessità Piero Dominici:

Da tempo, ormai, non sappiamo più guardare/osservare l’insieme, il sistema, l’intero, la globalità, il sistema di relazioni e/o interazioni che li caratterizzano; in altre parole, ne riconosciamo con difficoltà legami, correlazioni, nessi di causalità: proprio perché siamo stati educati e formati (nella migliore delle ipotesi) a descrivere, registrare regolarità, ai “come” e non ai “perché”; siamo stati educati e formati a cercare (?) e ad accontentarci di risposte semplici e/o pre-codificate (in ogni caso, ottenute in poco tempo), a cercare – dico sempre – soluzioni semplici a problemi (iper)complessi. E tale prospettiva, oltre ad essere miope e fuorviante, si rivela ancor più paradossale proprio perché viviamo (= conosciamo) nell’epoca dell’interconnessione globale, in cui tutti i processi sono interdipendenti e collegati tra loro (e lo saranno sempre di più): dobbiamo fare i conti con dimensioni e livelli di interazione e retroazione – a livello soggettivo, relazionale, sistemico, organizzativo, sociale – che mettono in evidenza, se ancora ce ne fosse bisogno, l’urgenza di ripensare i paradigmi in una prospettiva sistemica e della/sulla (iper)complessità.

A Dominici fa eco, con dovizia di particolari e informazioni, in un altro estratto dal suo saggio, “Nuova era oscura“, James Bridle, che definisce proprio il rapporto uomo/macchina, e quanto questo rapporto stia oramai alla base della definizione stessa del nostro mondo “reale“, quale che sia, per ciascuno di noi, la percezione del mondo fisico, più o meno “aumentato” dall’apporto/supporto delle macchine:

L’aeroporto è l’esempio canonico di quello che i geografi chiamano «codice/spazio». I rapporti codice/spazio descrivono l’intreccio della computazione con l’ambiente fisico e l’esperienza quotidiana a un livello molto specifico: anziché limitarsi a rivestirli e ad «aumentarli», la computazione ne diviene una componente cruciale, al punto che l’ambiente e l’esperienza dello stesso arrivano a cessare di esistere in assenza di programmazione.

Nel caso dell’aeroporto, il codice semplifica e al tempo stesso coproduce l’ambiente. Prima di arrivare in aeroporto, i passeggeri hanno a che fare con qualche sistema di prenotazione elettronica che registra i loro dati personali, li identifica e li rende visibili ad altri sistemi, come i banchi per il check-in e il controllo passaporti. Per caso, una volta in aeroporto, il sistema smettesse di funzionare, sarebbe ben più che un banale contrattempo: le moderne procedure di sicurezza hanno eliminato la possibilità di identificazione ed elaborazione cartacea, e il software è l’unico arbitro consentito in tutto il processo; non si potrebbe insomma fare nulla, e nessuno potrebbe andare da nessuna parte. Il risultato è che un software in crash revoca lo status di aeroporto all’intera struttura, trasformandola in un enorme hangar pieno di gente incazzata. Ecco quindi come il nostro ambiente viene coprodotto da una computazione in gran parte invisibile, la cui importanza cruciale si rivela solo nei momenti in cui viene a mancare – un po’ come un danno cerebrale.

Nel momento in cui gli smartphone diventano sempre più simili a computer adatti a tutti gli scopi e la computazione si dissolve in ogni singolo apparecchio che ci circonda – dagli elettrodomestici delle case smart ai sistemi di navigazione per le auto – il mondo intero si sta trasformando in un codice/spazio. Anziché rendere l’idea di codice/spazio obsoleta, questa assoluta ubiquità evidenzia il nostro fallimento nel comprendere l’impatto della computazione sul modo in cui pensiamo.

Quando acquistiamo un e-book da un servizio online, questo rimane di proprietà del venditore e il suo prestito può essere revocato in qualsiasi momento – come successe quando nel 2009 Amazon cancellò in remoto migliaia di copie di 1984 e de La fattoria degli animali dai Kindle dei suoi clienti. I servizi di musica e video filtrano i materiali disponibili in base alle singole giurisdizioni e determinano tramite algoritmi le preferenze personali. Le riviste accademiche determinano la possibilità di accesso alla conoscenza in base all’affiliazione istituzionale e ai contributi finanziari, mentre le biblioteche fisiche e pubbliche chiudono i battenti una dopo l’altra. L’attuale funzionamento di Wikipedia si regge su un esercito di agenti software – dei bot – per controllare e mantenere corretta la formattazione, creare connessioni tra un articolo e l’altro, moderare i contrasti e ridurre l’incidenza del vandalismo online; una recente indagine ha svelato che diciassette dei venti editor più prolifici di Wikipedia erano bot, che nell’insieme avevano prodotto circa il sedici percento di tutte le modifiche apportate al progetto enciclopedico

La computazione non si limita ad aumentare, circoscrivere e plasmare la cultura; operando al di sotto della nostra quotidiana, casuale consapevolezza della computazione stessa, diventa la cultura.

La computazione finisce per controllare tutto quanto stabilisce di mappare e modellare. Google ha deciso di indicizzare l’intera conoscenza umana, e si è così imposto sia come sorgente che come custode di quella conoscenza: è diventato ciò che le persone effettivamente pensano. Facebook si è proposto di mappare le connessioni tra persone – il diagramma sociale – ed è diventato la piattaforma per queste connessioni, riplasmando una volta per tutte le relazioni sociali. Come un sistema di controllo aereo che scambia uno stormo di uccelli per una flotta di bombardieri, il software è incapace di distinguere tra il proprio modello del mondo e la realtà – e, una volta condizionati, lo stesso vale per noi. Un simile condizionamento si verifica per due ragioni: perché la combinazione di opacità e complessità rende gran parte del processo computazionale indecifrabile; e perché la computazione in sé è percepita come politicamente ed emotivamente neutra. La computazione è opaca: ha luogo all’interno delle macchine, al di là dello schermo, in edifici remoti – all’interno, per così dire, di una nuvola (un cloud). E persino quando riusciamo a fendere questa opacità – per esempio grazie all’apprendimento diretto della programmazione e all’acquisizione di dati – rimane ben oltre la capacità di comprensione della gran parte di noi. L’aggregazione di sistemi complessi nelle applicazioni contemporanee in rete significa che nessuno è mai in grado di percepirla nel suo complesso. La fede nelle macchine è il presupposto essenziale per il loro utilizzo, e questo va a rinforzare altri pregiudizi cognitivi che vogliono le risposte automatizzate come intrinsecamente più affidabili di quelle non automatizzate.

La computazione è, a ogni livello, una sorta di hacking cognitivo che scarica sulla macchina sia il processo decisionale che la responsabilità. Man mano che la vita accelera, ecco arrivare la macchina a occuparsi di sempre maggiori incarichi cognitivi rafforzando così la sua autorità, a prescindere dalle conseguenze. Operiamo un costante restyling del mondo per fare spazio alle continue notifiche e alle scorciatoie cognitive forniteci dai sistemi automatizzati. La computazione rimpiazza il pensiero cosciente. Pensiamo sempre più come una macchina, oppure non pensiamo affatto.

Proprio come le telecomunicazioni globali hanno fatto collassare il tempo e lo spazio, la computazione ha fuso il passato con il futuro. Quanto viene raccolto in forma di dati viene plasmato nella realtà per come la conosciamo, e poi proiettato in avanti con l’implicito presupposto che le cose non cambieranno né divergeranno da ciò di cui si è fatto esperienza in passato. In questo modo la computazione non governa solo le nostre azioni nel presente, ma fabbrica un futuro che si accorda al meglio ai suoi parametri. Ciò che è possibile diventa ciò che è computabile. Ciò che è difficile quantificare o complicato da modellare, tutto ciò che non è mai stato visto prima o che non può essere localizzato all’interno di uno schema prestabilito, ciò che è incerto o ambiguo, viene escluso dal reame dei futuri possibili. La computazione proietta un futuro identico al passato – il che la rende incapace di gestire la realtà del presente, instabile per definizione.

Il pensiero computazionale ha trionfato perché prima ci ha sedotto con la sua potenza, poi ci ha disorientato con la sua complessità, e infine si è impiantato nelle nostre cortecce cerebrali come verità manifesta. I suoi effetti ed esiti, il suo stesso modo di pensare, fanno talmente parte della nostra vita quotidiana che opporvisi ci appare un’impresa tanto enorme e futile quanto quella contro il tempo atmosferico. Tuttavia riconoscere i molti modi in cui il pensiero computazionale si rivela essere il prodotto di eccessiva semplificazione, dati errati e offuscamento deliberato, ci consente anche di riconoscerne i fallimenti e di rivelarne i limiti.

Come dice, davvero in modo illuminato e preciso, un’altra saggista ed esperta di nuovi scenari economico-politici, Shoshana Zuboff, nel suo ultimo libro: “il capitalismo della sorveglianza“, sintetizzando in modo assai efficace alcuni dei possibili scenari futuri per la nostra società post rivoluzione industriale:

La strada che da Shenzen porta a un aeroporto americano conduce anche a un aspirapolvere Roomba che mappa il nostro salotto e alla nostra colazione in compagnia di Alexa. È la strada verso la certezza delle macchine imposta dal potere strumentalizzante e prodotta dal capitalismo della sorveglianza. E non è un viaggio così lungo come immaginate.

Siamo davanti a un bivio.

Da una parte si può andare verso una dichiarazione sintetica per una terza modernità, basata sul rafforzamento delle istituzioni democratiche e la costruzione creativa di un doppio movimento per la nostra epoca. È una strada nella quale ci serviamo del digitale per dare vita a un capitalismo dell’informazione che armonizzi domanda e offerta in modalità che contribuiscano davvero a migliorare la vita e che siano compatibili con un ordine sociale democratico. Il primo passo lungo questa strada è dare il giusto nome alle cose, stabilire dei punti di riferimento, ritrovare il nostro stupore e condividere la nostra giusta indignazione.

Seguendo l’altra strada, quella che ci ricollega a Shenzen, ci arrenderemo alla visione antidemocratica del capitalismo della sorveglianza per una terza modernità determinata dal potere strumentalizzante. È un futuro di certezza ottenuta senza violenza. Non ne pagheremo il prezzo con i nostri corpi, ma con la nostra libertà. È un futuro che ancora non esiste ma, come nel sogno del Natale futuro di Scrooge, è tutto pronto perché possa avverarsi.

E come ha commentato, un altro studioso e amico di Lsdi/digit, Ennio Martignago: “Un futuro di certezza ottenuta senza violenza di cui non pagheremo il prezzo con i nostri corpi, ma con la nostra libertà e la nostra anima“; riecheggiando il pensiero di un altro filosofo del nostro tempo, Rudolf Steiner. Un futuro in cui dovremmo riprendere a cibarci di cultura e non di upgrade tecnologici, che ci vengono imposti, per giunta, senza alcuna spiegazione e giustificazione sensata. Upgrade da cui dipende la nostra stessa vita – in talune circostanze – e che ci vengono affibbiati da meccanismi automatici in seguito a “malintesi” inconsapevoli – nella migliore delle ipotesi – o peggio, da deliberati e ripetuti attentati alla nostra intelligenza e alla nostra comprensione per renderci sempre più “stupidi e volutamente incapaci di comprendere“, invece di informati e consapevoli. Come argomenta, con grande precisione e chiarezza, il sociologo della complessità Piero Dominici, prendendo a prestito, la “visione” di Adriano Olivetti:

L’innovazione tecnologica è da sempre un fattore strategico di cambiamento dei sistemi sociali e delle organizzazioni ma se non supportata da una cultura della comunicazione, da una visione sistemica della complessità e, a livello di decisore politico, da politiche sociali in grado di innescare e supportare il cambiamento culturale, si rivela sempre un’innovazione mancata.

La società della conoscenza e il nuovo ecosistema globale sono destinati a diventare sempre più esclusivi e chiusi, anche in quei “luoghi” in cui non è ancora possibile erigere muri e barriere per gestire (?) la diversità, le disuguaglianze e i conflitti. La “società asimmetrica”, apparentemente aperta e inclusiva, in realtà garantisce opportunità di inclusione e mobilità solo in linea teorica e a livello di quadro giuridico di riferimento.

Parafrasando (e forzando) alcune parole, particolarmente significative, di Adriano Olivetti, il quale affermava “Io penso la fabbrica per l’uomo, non l’uomo per la fabbrica”, dobbiamo iniziare veramente a pensare (progettare) le città, i territori, gli ecosistemi, le reti, le pubbliche amministrazioni, i servizi etc. per (e con) il Cittadino e non viceversa; servizi, ambienti, spazi sociali che pongano concretamente, al di là degli slogans, “il cittadino al centro” (da sempre, preferisco parlare di “Persona al centro”, per tutta una serie di motivi su cui ritorneremo), mentre spesso l’impressione è che al centro ci sia ben altro…e mi riferisco non soltanto alla stessa tecnologia (opportunità), a logiche di potere e/o interessi particolari, ma anche ad una visione ideale, e lontana dalla realtà, proprio dei cittadini destinatari di politiche e servizi; cittadini che, una volta educati e “preparati” alla cittadinanza, potranno anche essere (concretamente!) sempre più coinvolti nei processi decisionali. Per ora siamo fermiall’illusione di una relazione meno asimmetrica con il potere.

Ringraziando, come sempre, per il loro contributo, tutti gli illustri pensatori coinvolti in questa nostra riflessione; e complimentandoci con tutti i lettori che, con sprezzo del pericolo e audacia non comune, sono riusciti ad arrivare sino a questo punto della narrazione, auguriamo a tutti una serena settimana e diamo appuntamento alla prossima occasione ;)