Che tradotto e sintetizzato dai nostri esperti potrebbe essere definito così:

“il GDPR è più orientato alla protezione dei dati che alla protezione dell’utente e delega direttamente alle aziende la possibilità di valutare l’entità del rischio aumentando la difficoltà dell’utente nelle evenuali contestazioni future. La reale efficacia di un regolamento del genere potrà essere davvero testata solo quando ci si troverà di fronte a casi concreti di violazione da parte di qualcuno (le stesse aziende) e alle successive contestazioni e richieste di tutela espresse dai singoli utenti. Solo in sede dibattimentale e solo al termine dei vari gradi di giudizio, si potrà valutare se questo nuovo regolamento sia più o meno efficace e in favore di chi “.

Insomma di sicuro aumenta il livello della protezione o meglio delle misure e della responsabilità che le aziende che “trattano” i nostri dati dovranno assumersi dal 25 maggio prossimo, e aumentano sicuramente le azioni che ogni azienda che assume i dati di utenti che transitano sul proprio sito a vario titolo (tutte diremmo per semplificare) dovrà farsi carico di mettere in atto per proteggere e tutelare tali dati. Probabilmente se anche negli Stati Uniti ci fosse stato un regolamento come questo non ci sarebbe stato nessuno scandalo “Cambridge analityca”; però – come sempre c’è un però, anzi forse ce ne sono alcuni – da qui nasce lo studio e la successiva riflessione del nostro Marco Dal Pozzo che si spinge un pochino più in là per riportarci al succo della questione e quindi lasciamo la tastiera con piacere a lui e buona lettura !

” qualsiasi informazione riguardante una persona fisica identificata o identificabile («interessato»); si considera identificabile la persona fisica che può essere identificata, direttamente o indirettamente, con particolare riferimento a un identificativo come il nome, un numero di identificazione, dati relativi all’ubicazione, un identificativo online o a uno o più elementi caratteristici della sua identità fisica, fisiologica, genetica, psichica, economica, culturale o sociale “

Alessandro Curioni, in un trattato molto interessante su questo regolamento, ”

La protezione dei dati ” , pone l’attenzione anche sulla definizione appena richiamata evidenziandone un vizio: non si può – possiamo riassumere così la sue osservazioni su questo specifico aspetto – definire un dato come informazione.

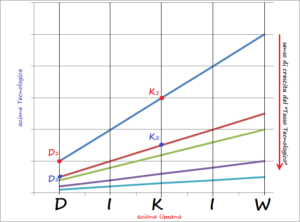

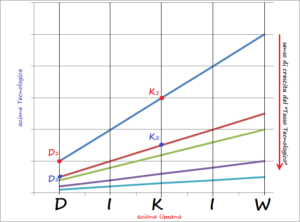

La premessa è di carattere tecnico e richiama lo schema WIKiD (Winsdom, Innovation, Knowledge, Information e Data) che descrive come l’evoluzione del “dato” a “informazione”, dell’“informazione” a “conoscenza”, della “conoscenza” a “innovazione” e dell’”innovazione” a “saggezza” o “benessere”, sia un percorso in cui agiscono sia l’elemento umano sia l’elemento tecnologico. Curioni sostiene che la definizione presente nel regolamento europeo denota un appiattimento del concetto di informazione e conoscenza sul concetto di dato: il dato personale non può essere né informazione personale (come vorrebbe invece la definizione dell’Art. 4 della normativa) né conoscenza personale.

L’informazione personale, esemplifica Curioni, è ciò che spiega la personalità e le convinzioni di una persona; la conoscenza personale è ciò che permette di dare un giudizio sulla persona e che quindi permette di influenzarla.

Il concetto dell’appiattimento è ancora più forte se lo schema WIKiD viene portato su un diagramma. L’artificio grafico ci dice con maggiore chiarezza che, all’aumentare del tasso tecnologico – cioè con l’imporsi di meccanismi di Intelligenza Artificiale – è molto più breve il percorso che separa il “dato” dall’”informazione” e poi dalla “conoscenza” (nella figura il percorso sulla retta blu dal punto D1 al punto K1 è maggiore del percorso sulla retta arancio dal punto D2 a quello K2): ciò che prima era quasi interamente a carico dell’uomo (lo scienziato, il giornalista, l’artista, per dire dei lavori intellettuali di ri-elaborazione di materiali grezzi verso livelli di conoscenza dei materiali stessi), l’evoluzione tecnologica ora delega alle macchine. Si potrebbe quindi dedurre che il lavoro dell’uomo diventa sempre più quello di costruzione dell’intelligenza artificiale (che è l’infrastruttura su cui poggia il nuovo scenario in cui il percorso si compie) a svantaggio di quello di ri-elaborazione degli elementi contemplati dallo schema.

Tornando al regolamento europeo e concludendo il ragionamento sullo spunto posto da Curioni: questo appiattimento nella definizione di “dato come informazione” nasconde – come si diceva – un vizio: è come se si stesse dando per scontato il forte peso del fattore tecnologico. Questo, di per sé, non sarebbe nemmeno un male se non fosse che poi il regolamento fugge dall’oggetto che invece andrebbe normato: non già la protezione del dato, che in sé non dice nulla, ma i meccanismi automatici che lo mettono in relazione ad altri dati di cui tali meccanismi dispongono come input: “il gruppo sanguigno in sé non dice nulla – dice Curioni. Molto di più dice il contesto in cui il gruppo sanguigno è noto, cioè l’informazione personale”.

Volendo spingerci un po’ oltre, quindi, quello che andrebbe davvero fatto da un punto di vista legislativo, non è solo normare la protezione dei dati, ma garantire trasparenza su come essi vengono trattati. Il tema è, quindi, ancora una volta, la trasparenza degli algoritmi.

La domanda retorica del titolo ci è parsa una buona base di partenza per introdurre una riflessione del “nostro” Marco Dal Pozzo sul GDPR. Il fantomatico, oramai non si può definire altrimenti, nuovo regolamento europeo sulla gestione e protezione dei dati personali (General Data Protection Regulation) che entrerà in vigore il prossimo e oramai vicinissimo 25 maggio. Il GDPR è : – come si legge nell’intestazione del documento che è possibile scaricare integralmente e in italiano sul sito di Privacy Italia – Il REGOLAMENTO (UE) 2016/679 DEL PARLAMENTO EUROPEO E DEL CONSIGLIO

La domanda retorica del titolo ci è parsa una buona base di partenza per introdurre una riflessione del “nostro” Marco Dal Pozzo sul GDPR. Il fantomatico, oramai non si può definire altrimenti, nuovo regolamento europeo sulla gestione e protezione dei dati personali (General Data Protection Regulation) che entrerà in vigore il prossimo e oramai vicinissimo 25 maggio. Il GDPR è : – come si legge nell’intestazione del documento che è possibile scaricare integralmente e in italiano sul sito di Privacy Italia – Il REGOLAMENTO (UE) 2016/679 DEL PARLAMENTO EUROPEO E DEL CONSIGLIO